Vývoj robotiky jde raketovým tempem

Kdo sledoval čínskou novoroční show, viděl roboty společnosti Unitree předvádět kung-fu choreografii s lidskými bojovníky.

Viděl plynulé přechody, kombinace úderů, schopnost se zotavit z chyby. A možná vás napadlo jak tohle vůbec funguje? Rozhodně ne tak, že by někdo ručně naprogramoval každý pohyb.

Moderní robotika funguje jinak a právě pochopení toho "jinak" je klíč k tomu, jaké skoky se nyní dějí. Roboti se pohyb neučí ze seznamu instrukcí, ale ze sledování. Systém projede stovky hodin videí nebo záznamů z pohybových senzorů na lidském těle, extrahuje z nich trajektorie pohybu a pak v počítačové simulaci odzkouší doslova miliony variant. V těhle simulacích robot padá, zkouší znovu, dostává "odměnu" za úspěch a "trest" za pád. Z toho vznikne model, který se pak přenese do reálného hardwaru robota.

Jenže i tenhle přístup měl doposud svoje omezení. Problém je ten, že i když každý pohyb trénujete přes videa a simulaci, musíte trénovat různé pohyby extra. Jeden natrénovaný model pro salto, jiný pro breakdance. Je to proto, že fyzika těchto pohybů je radikálně odlišná, jiné těžiště, jiné časování, jiné kontaktní body se zemí a jedna neuronová síť měla historicky problém obsáhnout všechno najednou bez toho, aby se pohyby navzájem trochu nerušily a kvalita každého pohybu se nezhoršila.

Nyní Projekt OmniXtreme od čínského výzkumného institutu BIGAI přichází s takovým malým převratem. Jednoduše vysvětleno na základě metafory, představme si klavíristu, který umí zahrát dvacet skladeb. Ale každou se učil zvlášť, trénoval tvrdě měsíce než jí vypiloval k dokonalosti.

OmniXtreme to ovšem mění a tvoří klavíristu, který se naučí hudební teorii tak perfektně, že dokáže zahrát libovolnou skladbu na první přečtení, aniž by ji někdy cvičil a dokonce v, jak silně má bouchnout do klávesnice. Noty jsou noty, nezáleží na tom, jestli je to Beethoven nebo jazz. Takže když se koukáme na video (1), řekneme si na první pohled, že je to stejné jako ti roboti z novoroční show. Ale není.

Souběžně s tím vyšel projekt Dimensional od amerického startupu, jehož tým pochází z MIT, CMU, Apple Robotics, Amazon Robotics a DJI. Řeší zdánlivě odlišný, ale stejně podstatný problém. Roboti dnes prostor kolem sebe vnímají, mají kamery, orientují se v prostoru. Problém je ale v tom, jak si tento prostor pamatují a jak nad ním uvažují v čase.

Doposud pracují agenti AI s pamětí podobně jako jazykové modely, ukládají záznamy a při dotazu v nich vyhledávají. Tento přístup funguje dobře tam, kde je kontext jazykový.

Fyzický svět ale není text, je to prostor, čas, pohyb a geometrie, a tyto věci textové vektory prostě nedokážou věrně zachytit.

Ten projekt Dimensional pracuje na jiném typu paměti, který autoři nazývají SpatialRAG. Fyzický prostor se rozdělí na malé trojrozměrné buňky a každá z nich se otaguje vektory zachycujícími polohu, čas, rozpoznané objekty i vizuální kontext.

Výsledkem je prostorová databáze světa, přes kterou může agent pokládat dotazy, které by dřív nedávaly smysl, např. kde jsem naposledy viděl klíče, kdo byl doma v pondělí, kdy se typicky vynáší odpadky. Systém funguje na humanoidech, dronech i čtyřnohých robotech a stejný software běží na mobilním telefonu, což dokazuje jak je model efektivní.

Když si představíte, že tyto dva projekty jednou poběží v jednom robotovi, přijde na mysl přirovnání k člověku, který se po letech tréninku vrátí domů. Tělo ví, jak se pohybovat, instinktivně, bez přemýšlení. A zároveň zná prostor, ví, kde jsou určité předměty, pamatuje si, kdo přišel minulý týden, chápe kontext. Teprve tohle spojení koordinovaného těla a paměti vybavené myslí dělá z robota něco, co přestává být strojem vykonávajícím příkazy a začíná se podobat autonomnímu účastníkovi prostředí.

Oba projekty jsou open-source a oba byly zveřejněny ve stejném týdnu, jde to neuvěřitelně rychle...

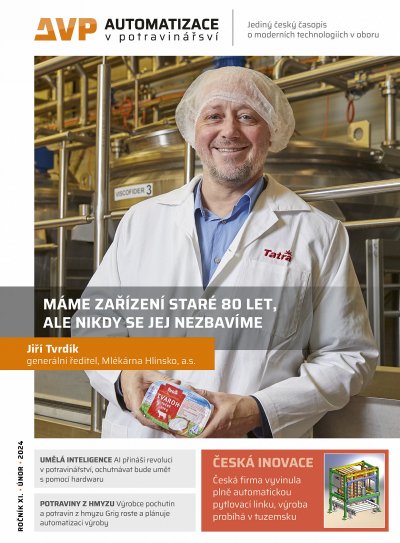

Automatizace v potravinářství

Automatizace v potravinářství